En résumé:

- PCWorld examine les pratiques de sécurité essentielles pour les nouveaux assistants personnels d’IA comme Claude Cowork et Perplexity’s Personal Computer qui offrent des capacités de contrôle de bureau étendues.

- Ces outils d’IA peuvent manipuler des fichiers, exécuter des commandes et accéder aux répertoires système, créant ainsi des risques de sécurité importants si les utilisateurs accordent des autorisations inappropriées ou partagent des données sensibles.

- Les principales recommandations incluent la désignation de dossiers d’espace de travail limités, l’utilisation de modes de planification pour l’examen des tâches et l’évitement de l’accès de l’IA aux documents confidentiels tels que les déclarations de revenus ou les coordonnées bancaires.

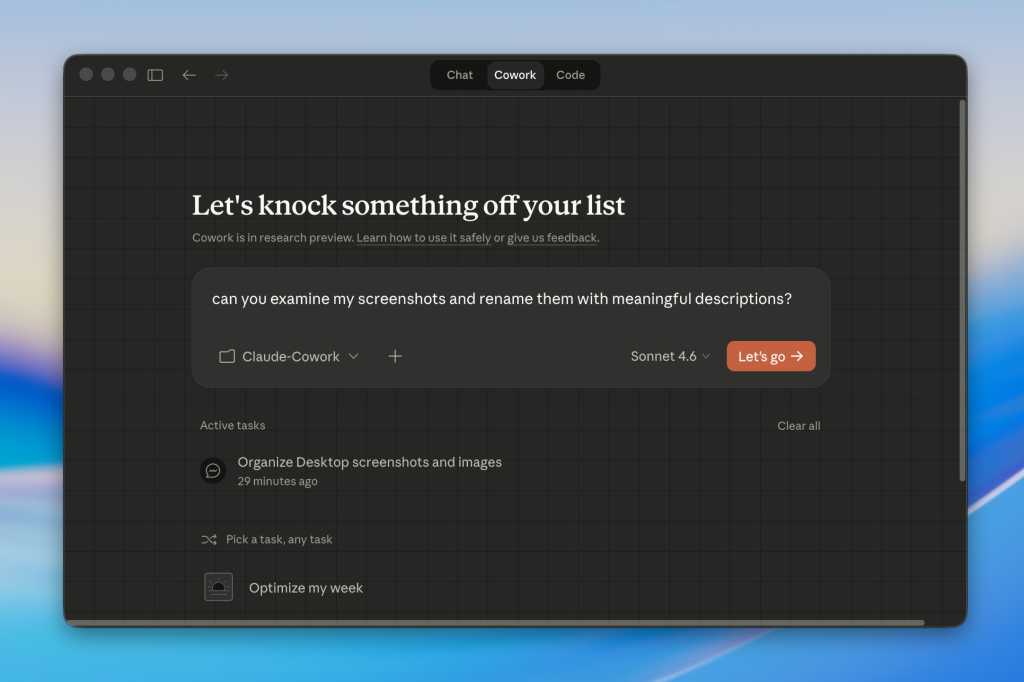

Une IA capable de renommer vos captures d’écran, d’organiser vos reçus, de ranger vos notes et de créer des applications, tout en étant occupé à autre chose ou même en dormant ?

Comptez sur moi.

De Claude Cowork à l’ordinateur personnel de Perplexity et au poste de travail de Manus, il y a eu une multitude d’assistants personnels d’IA qui vivent sur votre PC et prendront en charge votre bureau. Outre les intégrations habituelles avec Gmail, Outlook et Excel, ces applications peuvent réellement manipuler et modifier vos fichiers, ou exécuter des commandes « shell » qui leur donnent un accès sans précédent à votre système.

Contrairement à OpenClaw, l’outil d’IA viral open source qui a lancé tout l’engouement pour les agents d’IA personnels, Claude Cowork et les nouvelles applications de bureau de Perplexity et Manus, propriété de Meta, proviennent de grands acteurs commerciaux de l’IA, chacun avec des installateurs en un clic (ce qui signifie pas de problème avec GitHub) et des interfaces utilisateur élégantes.

Tout ce crachat et ce polissage peuvent vous faire penser que ces nouveaux assistants personnels d’IA sont parfaitement sûrs à utiliser. Ce n’est pas le cas.

Tout comme OpenClaw, Claude Cowork, l’ordinateur personnel de Perplexity et le poste de travail de Manus sont tous capables de faire des ravages sur votre système si vous les autorisez. Donnez-leur accès au mauvais répertoire ou laissez-les lancer des commandes sans surveillance appropriée, et vous pourriez vous retrouver avec un gâchis entre les mains.

Ne vous méprenez pas ; Claude Cowork et ses concurrents sont capables de réaliser des prouesses de productivité époustouflantes lorsqu’ils sont utilisés correctement, et je reviendrai bientôt sur leurs astuces les plus cool. Mais d’abord, abordons quelques conseils de sécurité de base, en commençant par…

Ne le faites pas donnez à votre assistant IA l’accès à un répertoire de haut niveau

L’une des premières choses que Claude Cowork vous demandera de faire est de désigner un dossier comme son « espace de travail ». Une fois que vous avez choisi un dossier, votre assistant IA aura un accès complet aux fichiers qu’il contient, ainsi qu’à tous les sous-répertoires ainsi qu’aux fichiers. dans ces sous-répertoires.

Maintenant, quand je parle d’accès complet, je veux dire que l’IA peut lire les fichiers, les indexer et les utiliser comme contexte pour répondre aux questions. Il peut même les renommer, les modifier ou les supprimer.

Toutes ces fonctionnalités peuvent conduire à des flux de travail incroyablement puissants (renommer et organiser des répertoires entiers de captures d’écran en fait partie), mais avec une mauvaise invite, votre IA pourrait effacer des pans de fichiers en un instant ou accéder à des fichiers sensibles que vous souhaitez garder cachés.

Donc, quoi que vous fassiez, ne donnez pas à Claude Cowork, à l’ordinateur personnel de Perplexity ou à un autre outil d’IA l’accès, par exemple, à votre répertoire de documents. C’est juste demander des ennuis.

Au lieu de cela, donnez-lui accès à un dossier plus petit situé plus bas dans l’arborescence des répertoires ou, mieux encore, accordez-lui l’accès à un nouveau répertoire vide, puis ajouter les fichiers et les dossiers que vous êtes à l’aise de toucher.

Ne le faites pas laissez-le accéder aux documents sensibles

Il peut être tentant de laisser votre assistant personnel IA s’en charger avec vos relevés bancaires, déclarations de revenus ou autres documents sensibles, mais c’est une mauvaise idée.

Même si certains outils d’assistant d’IA comme Claude Cowork n’entraînent pas leurs modèles sur vos données, votre fichier peut toujours être exposé à des attaques par « injection d’invites », c’est-à-dire des fichiers avec des invites cachées qui pourraient inciter Claude ou une autre IA à télécharger des informations sensibles vers l’attaquant.

Pour cette raison, vous devriez réfléchir à deux fois avant d’ajouter quoi que ce soit contenant des identifiants personnels tels que des numéros de sécurité sociale, des numéros de compte bancaire ou tout autre élément que vous ne voulez pas tomber entre de mauvaises mains.

Un bon conseil que j’ai retenu est le suivant : avant d’autoriser votre assistant IA à accéder à un fichier, demandez-vous si vous seriez à l’aise de placer le fichier dans une application de chat. Si la réponse est non, conservez ce fichier hors de l’espace de travail de votre IA.

Faire mettez votre assistant IA en laisse serrée

Il en va de même pour les agents de codage IA. La plupart des assistants personnels d’IA vous demanderont quel niveau de surveillance vous souhaitez sur leurs activités.

À l’extrémité la plus prudente du spectre, vous pourrez peut-être approuver chaque commande avant que votre IA ne l’exécute – ou, à l’autre extrémité, vous pouvez jeter la prudence au vent, permettant à votre assistant d’exécuter ses commandes de manière autonome pendant que vous dormez.

Maintenir l’approbation de chaque mouvement de votre assistant IA est, bien sûr, l’option la plus sûre, mais c’est aussi la plus fastidieuse et vous pourriez rapidement devenir ennuyé de devoir cliquer sur « approuver » pour chaque action. Pourtant, donner à votre IA le contrôle total de ses actions pourrait être une recette pour un désastre si vous lui donnez des instructions erronées ou imprécises.

La clé est de trouver un terrain d’entente raisonnable, qui permette à l’IA d’agir comme un véritable assistant autonome sans simplement la lâcher. Par exemple, vous pouvez autoriser Cowork ou un autre assistant IA à exécuter certaines commandes telles que celles en lecture seule, de manière autonome (« Toujours autoriser »), tout en conservant les commandes potentiellement destructrices sur une base obligatoire (« Autoriser une fois »).

Faire demander un plan

Une nouvelle tendance bienvenue dans les outils de codage de l’IA concerne les modes de « planification », dans lesquels l’agent peut planifier en détail ce qu’il va faire avant de le faire. La même chose est possible avec les assistants personnels d’IA.

Au lieu de leur ordonner de renommer tous les fichiers de votre espace de travail, puis de croiser les doigts, donnez-leur une invite du type : « Élaborez un plan pour renommer toutes les captures d’écran de mon répertoire de travail ; ne mettez pas encore en œuvre le plan, mais restez en mode crayon et papier », puis laissez l’IA détailler comment cela va procéder.

Examinez attentivement le plan et apportez les modifications nécessaires avant de donner votre approbation.

Faire sauvegardez vos données

Même dans un espace de travail en bac à sable, il est possible que Claude Cowork et d’autres assistants personnels d’IA corrompent ou suppriment involontairement vos fichiers, et même si les métadonnées de vos fichiers peuvent être préservées, les données réelles peuvent ne pas l’être.

Pour cette raison, il est essentiel que vous sauvegardiez tous les fichiers critiques avant de permettre à votre IA de les manipuler. Si cela n’est pas réalisable, vous devriez peut-être conserver vos données impossibles à perdre hors de l’espace de travail de votre IA.