Il n’y a pas d’évasion. L’intelligence artificielle se glisse dans les fenêtres, et avec elle vient une augmentation des exigences de stockage du système d’exploitation.

Pendant longtemps, la spécification de stockage minimale de Windows 11 était de 64 Go. Avec Copilot + PC plus récent, cela a été augmenté jusqu’à 256 Go. Mais cela ne s’arrête pas ici. C’est juste pour le système d’exploitation lui-même. Alors que de plus en plus de développeurs mettent en œuvre des modèles d’IA dans leurs applications, vous aurez besoin Encore plus de stockage – Pour gérer le système et les applications.

Plongeons dans ce que tout cela signifie et pourquoi cela se produit. Si vous souhaitez utiliser les fonctionnalités d’IA système (comme Windows Rappel) et les modèles d’IA générationnels hébergés localement (comme Deepseek) et les modèles de diffusion (comme la diffusion stable), vous ne pouvez pas simplement vous concentrer sur les NPU. Faites également attention au stockage.

Exigences actuelles d’espace de stockage d’IA

Microsoft fournit des conseils clairs sur les exigences du système Windows pour les modèles d’IA. Le copilote + PC axé sur l’IA de la société comprend une spécification matérielle minimale, et Copilot + PCS doit avoir au moins 256 Go de stockage pour se qualifier pour la marque Copilot +.

Cela peut ne pas sembler beaucoup, mais c’est un énorme saut du minimum précédent de 64 Go de Windows 11. Un exigence de stockage minimum de copilote + PC est de 4x de plus qu’un PC Windows 11 à la vanille.

Pourquoi la bosse? Cela semble étrange à première vue. Microsoft expédie les fenêtres avec quelques modèles d’IA regroupés dans une poignée d’applications, comme Microsoft Paint et Photos, mais ils ne consomment pas encore de gobes de stockage. Windows 11 occupe environ 38 Go sur mon ordinateur portable Microsoft Surface 7 – qui est l’un de ces Copilot + PC – tandis que le même système d’exploitation utilise environ 41 Go sur mon PC de bureau de cinq ans.

Tout cela est susceptible de changer à mesure que les modèles d’IA évoluent.

Les modèles AI auront besoin de plus de stockage bientôt

Lorsque les gens parlent de la «taille» d’un modèle d’IA, ils font référence au nombre de «paramètres» qu’il contient. Un paramètre est une variable dans le modèle AI qui détermine comment il génère la sortie, et tout modèle AI donné peut avoir des milliards de ces paramètres.

Également appelés poids du modèle, ces paramètres occupent l’espace de stockage pour fonctionner correctement – et lorsqu’un modèle d’IA a des milliards de paramètres, les exigences de stockage peuvent rapidement ballon.

Voici quelques exemples actuels:

- Google Gemma 2 – 1,71 Go (2 milliards de paramètres)

- Meta Llama 3.1 – 4,92 Go (8 milliards de paramètres)

- QWEN 2.5 CODER – 8,52 Go (14 milliards de paramètres)

- Meta Llama 3.3 Instruct – 37,14 Go (70 milliards de paramètres)

- Deepseek V3 – 221,25 Go (671 milliards de paramètres)

Comme vous pouvez le voir, l’espace de stockage consommé par un LLM augmente avec la taille de ses paramètres. Il en va de même pour d’autres types de modèles d’IA génératifs. Par exemple, la diffusion stable V1.4 occupe environ 4 Go tandis que la diffusion stable XL consomme plus de 13 Go. Whisper d’Openai, un modèle de parole à texte, consomme entre 1 Go et 6 Go selon que vous choisissiez une variante légère ou le modèle complet.

Mais il y a autre chose qui augmente également avec la taille des paramètres d’un modèle d’IA: son intelligence. LLAMA 3.1 405B, la plus grande version du modèle AI de META, a marqué 88,6 sur la référence MMLU, ce qui signifie qu’il a correctement répondu 88,6% des questions dans la référence. Pendant ce temps, le modèle Leser Llama 3.1 70b a marqué 86 et le LLAMA 3.1 8B encore moins inférieur a marqué 73.

Pour être clair, il existe des moyens d’améliorer l’intelligence des modèles d’IA sans augmenter les paramètres. Ce fut une innovation clé de Deepseek-V3, le modèle d’IA chinois qui a émergé de nulle part en décembre 2024 avec des performances qui rivalisaient avec le meilleur d’Openai.

Pourtant, les meilleurs modèles d’IA sont massifs. Deepseek-V3 est présumé plus petit que les modèles d’Openai – je dis «présumé» car Openai ne divulgue pas le nombre de paramètres pour ses modèles de pointe – et pourtant il dépasse encore 220 Go. La plupart des applications ne nécessiteront pas une installation locale de Deepseek-V3 pour alimenter les fonctionnalités AI, mais elles pourraient vouloir utiliser des modèles de taille moyenne comme Qwen 2.5 14b (8,52 Go) ou LLAMA 3.3 70b (37,14 Go).

Et cela empire pour votre disque dur, car différents modèles d’IA ont des forces différentes. Certains sont meilleurs pour écrire en langage naturel tandis que d’autres sont optimisés pour un raisonnement logique ou une planification étape par étape. Cela signifie que vous ne pouvez pas simplement vous débrouiller avec un modèle d’IA installé localement. Vous en aurez probablement quelques-uns. Peut-être des dizaines.

Autres besoins de données au-dessus des modèles d’IA

D’accord, rembobinons un peu. Les modèles AI pourraient occuper beaucoup d’espace de stockage à l’avenir, mais oubliez cela pendant une seconde. À l’heure actuelle, au début de 2025, ces grands modèles d’IA ne jouent pas un grand rôle dans les systèmes Windows 11. Alors pourquoi Microsoft a-t-il besoin d’au moins 256 Go de stockage pour Copilot + PCS? Cela semble un peu agressif, non?

Cela revient à une chose: les données. Plus précisément, les données nécessaires aux modèles d’IA pour faire leur truc. Des données qui ne font pas partie du modèle lui-même.

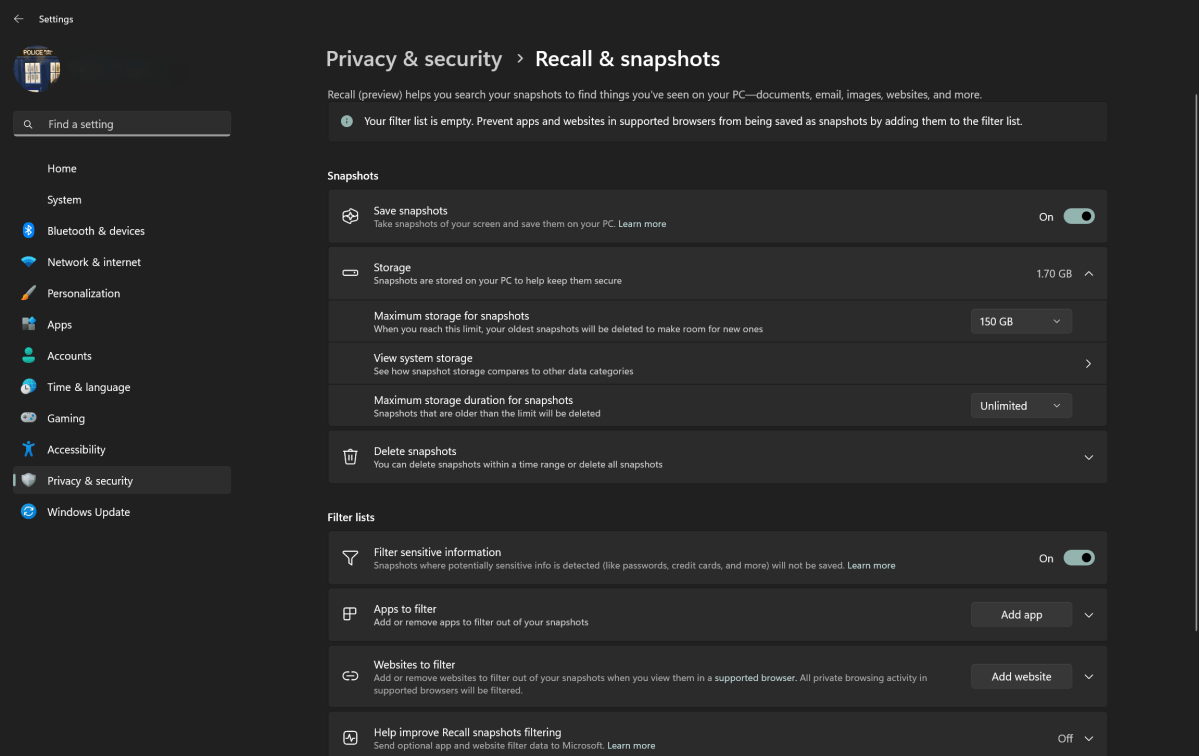

Le rappel de Windows est l’exemple pratique parfait. Le rappel prend des captures d’écran périodiques de votre bureau Windows pendant que vous l’utilisez, qui sont stockés localement sur votre PC. Ces captures d’écran sont un enregistrement exécutif de votre activité PC. Rappel applique l’IA pour analyser ces captures d’écran et créer un «index sémantique» consultable de toutes vos activités PC passées, que vous pouvez ensuite rechercher et vous référer vous-même.

Par exemple, j’ai écrit plusieurs articles sur Deepseek. Donc, lorsque je recherche «Deepseek» dans Windows Rappel, je vois des résultats qui couvrent les pages Web que j’avais ouvertes lors de la recherche du modèle. Rappel utilise l’IA pour comprendre toutes mes activités passées et me montrer ces moments passés qui sont pertinents pour tout ce que je recherche.

Toutes ces données doivent être stockées quelque part! Et cela prend beaucoup d’espace. (Microsoft ne vous permettra même pas d’allumer Windows Rappel à moins que vous ayez au moins 50 Go de stockage gratuit.) Cet espace n’est pas immédiatement utilisé, bien sûr. Il faut un certain temps pour que ces données s’accumulent. Mais il s’accumule.

Pour moi, Windows 11 dit que Rappel consomme 1,7 Go. C’est avec moi en utilisant le rappel pendant quelques mois pendant quelques heures par jour. À ce rythme, je ne serais pas surpris s’il pèse 20 Go d’ici la fin de 2025.

Alors, de quelle taille de stockage avez-vous besoin?

Si vous êtes intéressé à exécuter les fonctionnalités et les modèles d’IA localement, je vous recommande d’acheter un PC Windows avec au moins 1 To de stockage. Cela ne considère cependant que les besoins de l’IA. Si vous deviez utiliser 1 To pour d’autres choses – comme des jeux ou des vidéos – puis augmenter jusqu’à 2 To. Si vous voulez être à l’épreuve du temps, peut-être le faire monter jusqu’à 4 To, potentiellement en installant un SSD par vous-même.

C’est beaucoup de stockage, je sais. Mais cela gérera facilement la plupart des modèles d’IA locaux qui sont actuellement disponibles aujourd’hui. Alors que de plus en plus d’applications commencent à utiliser des modèles d’IA hébergés localement et à s’appuyer sur des données stockées localement, nous allons être choqués par la quantité de RAM et de stockage dont nous avons besoin.

Lire plus approfondie: Outils IA gratuits qui s’exécutent localement sur votre PC