De nombreux utilisateurs sont préoccupés par ce qui arrive à leurs données lors de l’utilisation de chatbots AI basés sur le cloud comme Chatgpt, Gemini ou Deepseek. Alors que certains abonnements prétendent empêcher le fournisseur d’utiliser des données personnelles entrées dans le chatbot, qui sait si ces termes se tiennent vraiment. Vous avez également besoin d’une connexion Internet stable et rapide pour utiliser Cloud AI. Mais s’il n’y a pas de connexion Internet, quoi alors? Eh bien, il y a toujours une alternative.

Une solution consiste à exécuter les applications AI localement. Cependant, cela nécessite que l’ordinateur ou l’ordinateur portable ait la bonne quantité de puissance de traitement. Il existe également un nombre croissant d’applications standard qui reposent sur l’IA maintenant. Mais si le matériel d’un ordinateur portable est optimisé pour l’utilisation de l’IA, vous pouvez travailler plus rapidement et plus efficacement avec les applications d’IA.

Travailler avec des applications d’IA locales a du sens

L’exécution des applications AI localement réduit non seulement la dépendance aux plates-formes externes, mais elle crée également une base fiable pour la protection des données, la souveraineté des données et la fiabilité. En particulier dans les petites entreprises avec des informations clients sensibles ou dans les ménages privés avec des données personnelles, l’utilisation locale de l’IA augmente la confiance. L’IA locale reste utilisable même si les services Internet sont perturbés ou si le fournisseur de cloud a des problèmes techniques.

La vitesse de réaction s’améliore considérablement car les processus informatiques ne sont pas ralentis par les temps de latence. Cela permet l’utilisation de modèles d’IA dans des scénarios en temps réel tels que la reconnaissance d’image, la génération de texte ou le contrôle vocal sans délai.

De plus, vous pouvez apprendre à utiliser l’IA complètement gratuitement. Dans de nombreux cas, le logiciel nécessaire est disponible entièrement gratuitement en tant que solution open source. Apprenez à utiliser l’IA avec les outils et bénéficiez de l’utilisation de la recherche soutenue par l’IA dans votre vie privée également.

Pourquoi la NPU fait la différence

Sans NPU spécialisé, même les cahiers modernes atteignent rapidement leurs limites dans les applications d’IA. Les modèles de langage et le traitement d’image nécessitent une énorme puissance de calcul qui submerge le matériel conventionnel. Il en résulte des temps de chargement longs, des processus lents et une durée de vie considérablement réduite de la batterie. C’est précisément là que l’avantage d’une NPU intégrée entre en jeu.

Le NPU gère les parties à forte intensité de calcul du traitement d’IA indépendamment et ne s’appuie pas sur le CPU ou le GPU. En conséquence, le système reste globalement réactif, même si un service d’IA s’exécute en arrière-plan ou que le traitement d’image AI est en cours. Dans le même temps, la température de fonctionnement reste basse, les ventilateurs restent silencieux et l’appareil s’exécute de manière stable, même en fonctionnement continu. Pour les applications d’IA locales, la NPU n’est donc pas un module complémentaire, mais une exigence de base pour des performances lisses et utilisables.

Les NPU accélèrent considérablement l’IA localement une fois de plus

En tant qu’accélérateurs d’IA spécialisés, les NPU permettent de fonctionner efficacement sur les modèles à forte intensité de calcul sur les dispositifs d’extrémité standard. Cela réduit la consommation d’énergie par rapport aux approches purement basées sur CPU ou GPU et rend l’IA local intéressant en premier lieu.

Une NPU est une puce spéciale pour accélérer les tâches où les processeurs conventionnels fonctionnent inefficaces. NPU signifie «Unité de traitement neuronal». Ces réseaux sont utilisés dans les modèles de langues, la reconnaissance d’image ou les assistants en IA. Contrairement à un CPU, qui exécute de manière flexible divers programmes, un NPU se concentre sur les calculs qui sont constamment effectués dans le domaine de l’IA. Cela lui permet de fonctionner beaucoup plus rapidement et plus économiquement.

Une NPU prend précisément les tâches où un processeur atteint ses limites. Les applications AI calculent avec un grand nombre de nombres en même temps, souvent sous forme de matrices. Ce sont des tables de nombres avec des lignes et des colonnes. Dans l’IA, ils aident à structurer et à calculer de grandes quantités de données. Les textes, les images ou la langue sont convertis en nombres et représentés sous forme de matrices. Cela permet à un modèle d’IA de réaliser efficacement les processus informatiques.

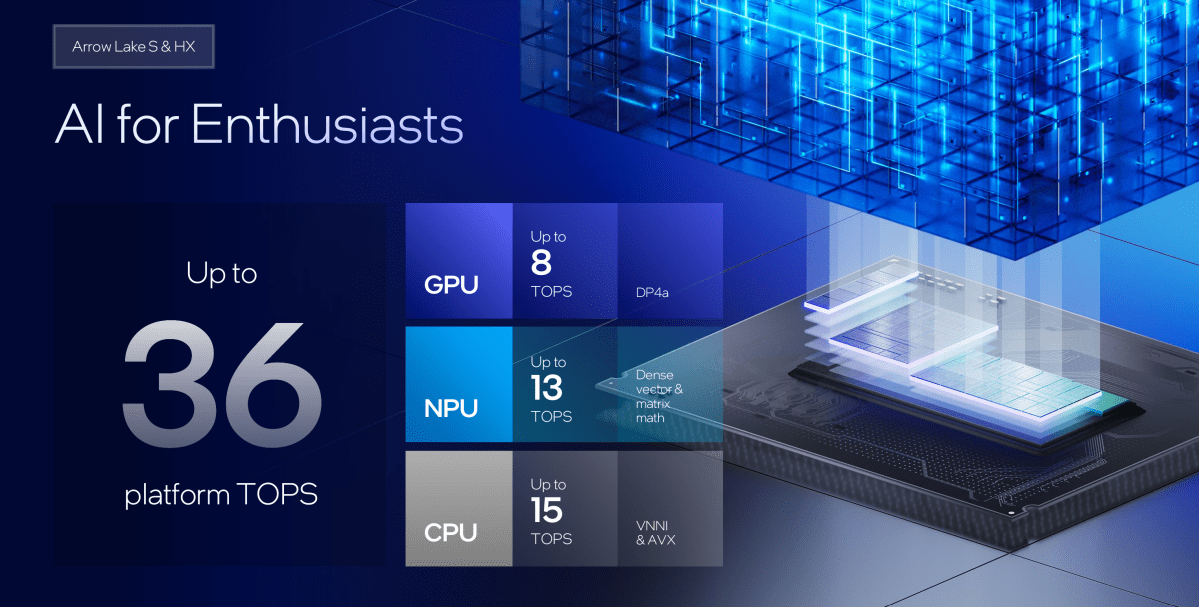

Les NPU sont conçus pour traiter simultanément de nombreuses matrices. Le CPU traite de tels modèles arithmétiques l’un après l’autre, ce qui coûte le temps et l’énergie. Un NPU, en revanche, a été spécialement conçu pour effectuer de nombreuses opérations de ce type en parallèle.

Pour les utilisateurs, cela signifie que le NPU traite les tâches AI telles que l’entrée vocale, la reconnaissance d’objets ou la génération automatique de texte plus rapidement et plus efficacement. Pendant ce temps, le CPU reste gratuit pour d’autres tâches telles que le système d’exploitation, le navigateur Internet ou les applications de bureau. Cela garantit une expérience utilisateur fluide sans retards ni consommation d’énergie élevée. Les appareils modernes tels que les ordinateurs portables avec Intel Core Ultra ou Qualcomm Snapdragon X Elite intègrent déjà leurs propres NPU. Apple utilise également une technologie similaire dans ses puces depuis des années (Apple Silicon M1 à M4).

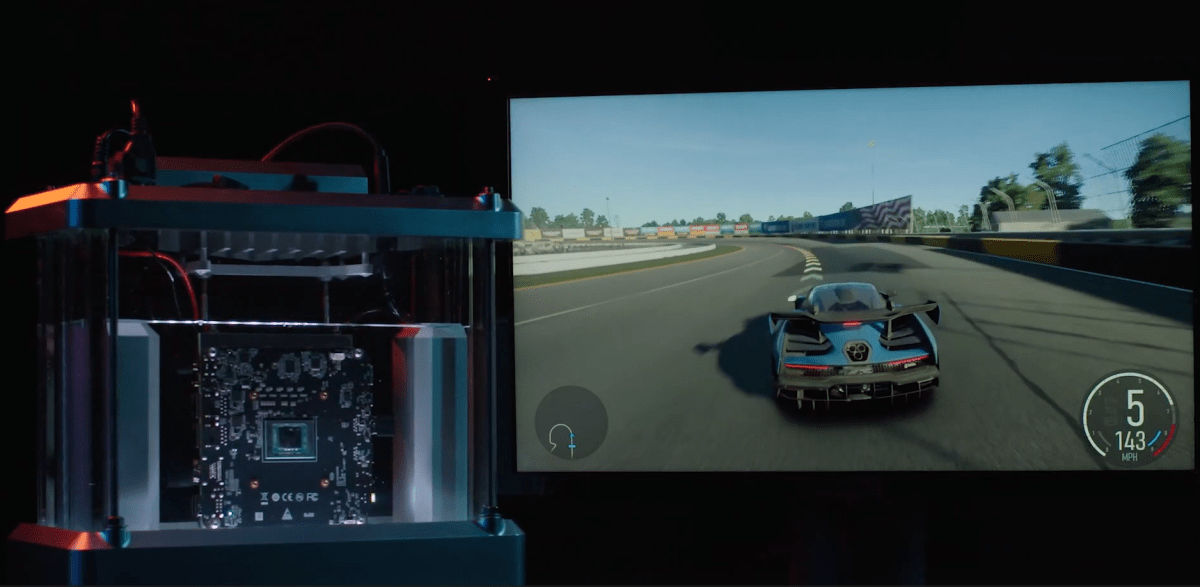

Les applications soutenues par l’IA s’exécutent localement et réagissent rapidement sans transférer des données vers des serveurs cloud. Le NPU garantit un fonctionnement en douceur pour le traitement d’image, la reconnaissance de texte, la transcription, l’entrée vocale ou les suggestions personnalisées. Dans le même temps, il réduit l’utilisation du système et économise la batterie. Il vaut donc la peine d’opter pour des ordinateurs portables avec une puce NPU, surtout si vous travaillez avec des solutions d’IA. Ce ne sont pas nécessairement des chatbots d’IA spéciaux. De plus en plus d’applications et de jeux locaux utilisent l’IA, même Windows 11 lui-même.

Open Source apporte AI localement à votre ordinateur: Olllama et Open Web UI

Des solutions open source telles que Olllama vous permettent d’exécuter gratuitement des LLM sur un ordinateur portable avec une puce NPU. LLM signifie «Modèle de grande langue». Les LLMS forment le cœur des applications d’IA. Ils permettent aux ordinateurs de comprendre le langage naturel et de y réagir de manière significative.

Quiconque utilise une IA pour écrire des textes, résumer les e-mails ou répondre aux questions interagit avec un LLM. Les modèles d’IA aident à formuler, à expliquer, à traduire ou à corriger. Les moteurs de recherche, les assistants linguistiques et les éditeurs de texte intelligents utilisent également des LLM en arrière-plan. Le facteur décisif ici n’est pas seulement les performances du modèle, mais aussi où elle fonctionne. Si vous utilisez un LLM localement, vous pouvez connecter des applications AI locales à ce modèle local. Cela signifie que vous ne dépendez plus d’Internet.

Olllama permet le fonctionnement de nombreux LLM, y compris les libres. Il s’agit notamment de Deepseek-R1, Qwen 3, Llama 3.3 et bien d’autres. Vous installez simplement Olllama sur votre PC ou ordinateur portable avec Windows, Linux et MacOS. Une fois installé, vous pouvez faire fonctionner Olllama via la ligne de commande dans Windows ou le terminal dans MacOS et Linux. Olllama fournit le cadre par lequel vous pouvez installer divers LLM sur votre PC ou ordinateur portable.

Pour travailler avec Ollama de la même manière que vous êtes habitué aux applications AI telles que Chatgpt, Gemini ou Microsoft Copilot, vous avez également besoin d’un frontal Web. Ici, vous pouvez compter sur la solution d’interface utilisateur OpenWeb, qui est également gratuite. Ceci est également disponible en tant qu’outil gratuit et open-source.

Quels autres outils d’IA locaux sont disponibles?

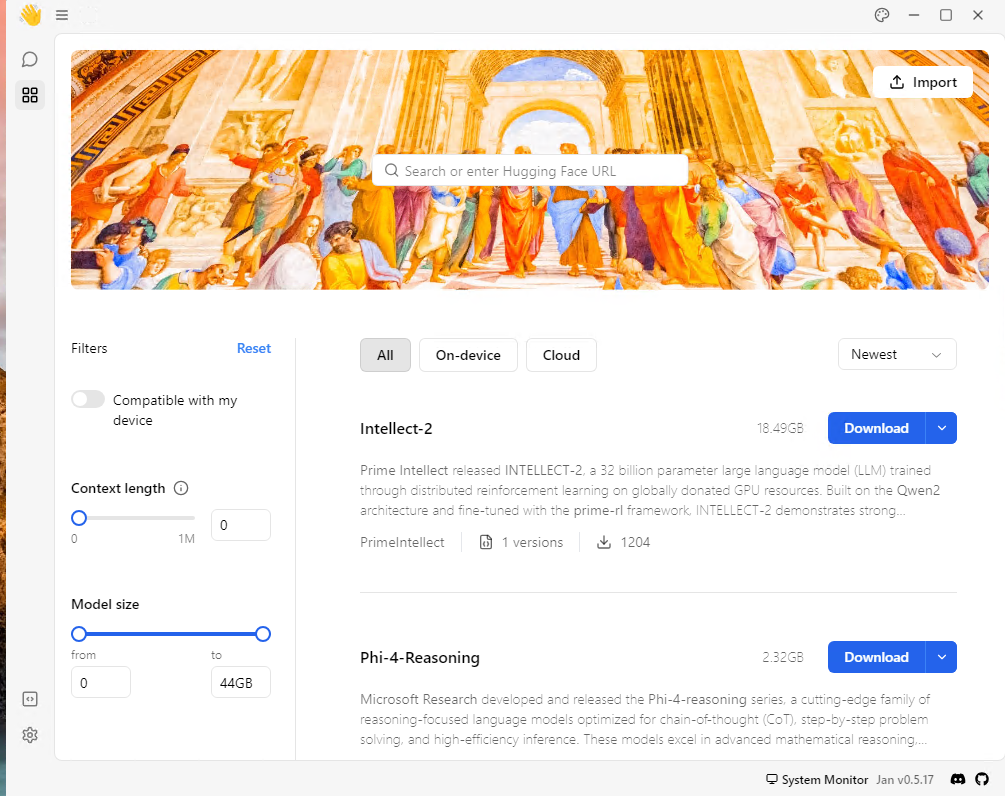

En tant qu’alternative à Ollama avec une interface utilisateur Web ouverte, vous pouvez également utiliser l’outil plus limité GPT4ALL. Une autre option dans ce domaine est janvier, qui donne accès à des LLM bien connues telles que Deepseek-R1, Claude 3.7 ou GPT 4 d’Openai. Pour ce faire, installez janvier, démarrez le programme et sélectionnez le LLM souhaité.

Veuillez noter, cependant, que les téléchargements du modèle peuvent rapidement atteindre 20 Go ou plus. De plus, il est logique de les utiliser si le matériel de votre ordinateur est optimisé pour l’IA, idéalement avec une NPU existante.