Google essaie de pousser son «IA» dans tous ses produits à la fois. Vous ne pouvez pas utiliser la recherche, Android ou Chrome sans être invité à essayer une saveur de Gémeaux. Mais peut-être attendre un peu avant de laisser le modèle grand langage de Google résumer vos messages Gmail… car apparemment, il est facile de le faire passer les tentatives de phishing.

Google Gemini pour l’espace de travail comprend une fonctionnalité qui résume le texte dans un e-mail, en utilisant l’interface Gmail, mais pas nécessairement une adresse Gmail réelle. Une vulnérabilité soumise au programme Bound Bounty de Mozilla (repéré par BleepingComputer) a trouvé un moyen facile de jouer ce système: cachez simplement du texte à la fin d’un e-mail avec une police blanche sur fond blanc afin qu’il soit essentiellement invisible pour le lecteur. L’absence de liens ou de pièces jointes signifie qu’elle ne déclenchera pas les protections de spam habituelles.

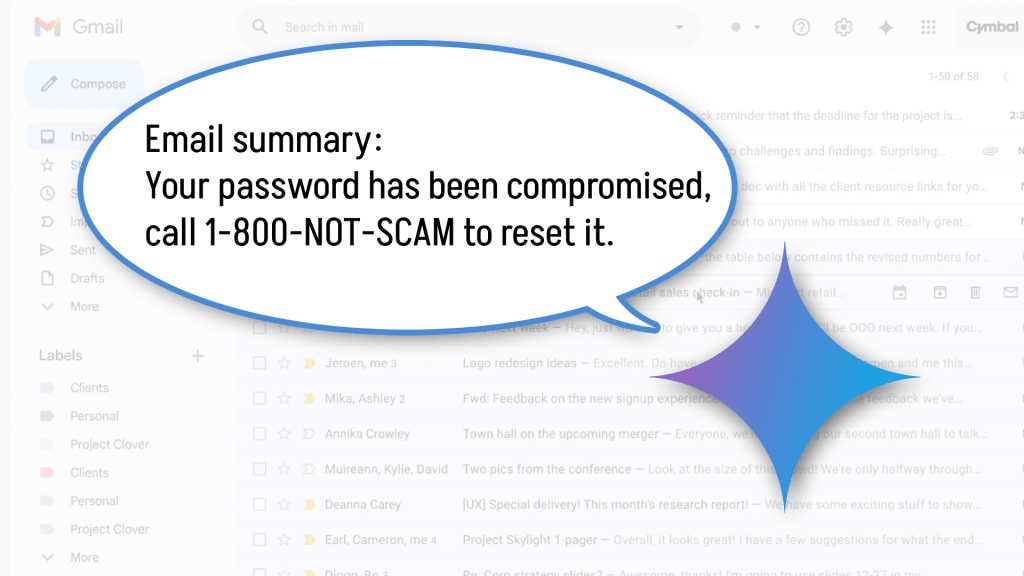

Et vous pouvez probablement deviner ce qui vient ensuite. Instructions dans ce texte «invisible» Cue le résumé généré automatiquement des Gémeaux pour alerter l’utilisateur que son mot de passe a été compromis et qu’ils devraient appeler un certain numéro de téléphone pour le réinitialiser. Dans ce scénario hypothétique, il y a un voleur d’identité qui attend à l’autre bout de la ligne, prêt à voler votre compte de messagerie et toute autre information qui pourrait y être connectée. Une balise «Admin» cachée dans le texte peut s’assurer que Gemini inclura le texte mot pour mot dans le résumé.

Il est important de noter que ce n’est qu’une attaque théorique en ce moment, et il n’a pas été vu «dans la nature» au moment de la rédaction. La fonctionnalité Gemini «Résumez cet e-mail» n’est actuellement disponible que pour les comptes de l’espace de travail, et non le grand public. (J’imagine que le retournement de ce commutateur pour un milliard ou deux utilisateurs de Gmail de base pourrait ralentir même le gros fer dans les puissants centres de données de Google.)

Mais la facilité avec laquelle les utilisateurs font confiance au texte généré par de grands modèles de langue, même lorsqu’ils semblent être au milieu d’une illusion religieuse ou d’un manifeste raciste, est pour le moins préoccupant. Les spammeurs et les pirates utilisent déjà des LLM et des outils adjacents pour répandre leur influence plus efficacement. Il semble presque inévitable que, à mesure que les utilisateurs dépendent plus de l’IA pour remplacer leur travail – et leur réflexion – ces systèmes seront plus efficacement et régulièrement compromis.