En résumé:

- PCWorld rapporte que de nouvelles recherches sur Nature Medicine révèlent que ChatGPT Health n’a pas réussi à reconnaître les urgences médicales dans 51,6 % des cas, conseillant plutôt aux patients de rester à la maison.

- L’IA a été particulièrement confrontée à des symptômes complexes, qui s’aggravent rapidement et qui pourraient mettre la vie en danger, posant des risques importants pour la sécurité des utilisateurs cherchant des conseils médicaux.

- Alors qu’OpenAI revendique un perfectionnement continu du modèle et conteste l’applicabilité de l’étude dans le monde réel, la recherche met en évidence les limites actuelles des outils d’évaluation médicale de l’IA.

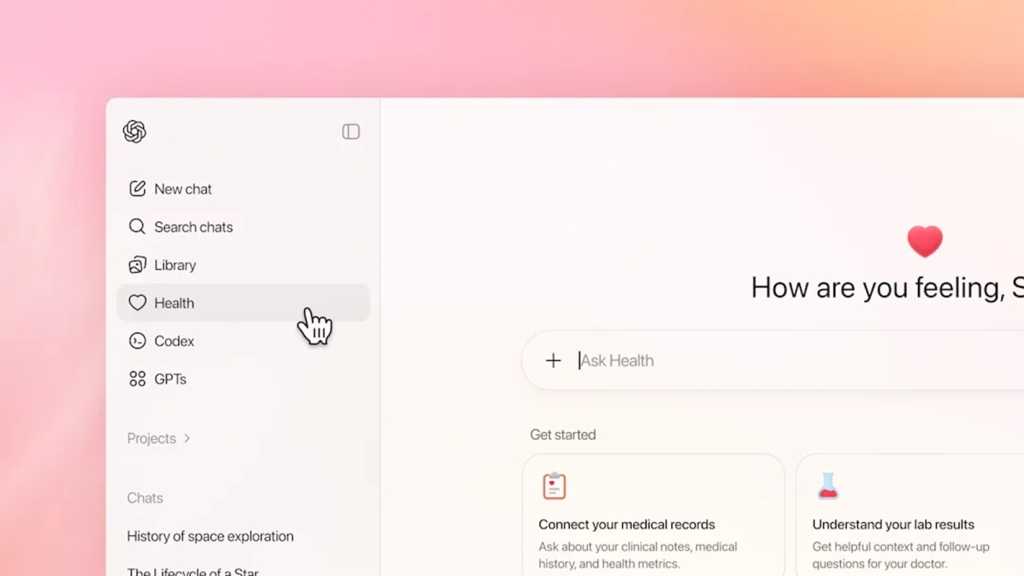

Selon une nouvelle étude publiée dans Médecine naturelleChatGPT Health (le chatbot dédié basé sur l’IA d’OpenAI, « conçu pour la santé et le bien-être », lancé plus tôt cette année) n’a pas réussi à identifier les urgences médicales nécessitant des soins médicaux immédiats, rapporte Le gardien.

Le chercheur principal, le Dr Ashwin Ramaswamy, et ses collègues, ont créé « 60 scénarios réalistes de patients couvrant des problèmes de santé allant de maladies bénignes aux urgences », qui ont été examinés par des médecins indépendants sur la base de directives cliniques établies.

Dans 51,6 % des cas où les patients auraient dû être envoyés à l’hôpital pour des soins d’urgence, il leur a plutôt été conseillé de rester à la maison et/ou de prendre rendez-vous chez le médecin.

ChatGPT Health a assez bien fonctionné dans des situations d’urgence claires, comme dans le cas d’accidents vasculaires cérébraux et de réactions allergiques graves, mais il n’a pas été aussi performant lorsque les symptômes étaient plus complexes et ne constituaient pas encore des urgences, mais pouvaient très rapidement mettre la vie en danger.

« Si vous souffrez d’insuffisance respiratoire ou d’acidocétose diabétique, vous avez 50/50 de chances que cette IA vous dise que ce n’est pas grave », a déclaré le doctorant Alex Ruani. « Huit fois sur 10, (ChatGPT Health) a envoyé une femme étouffée à un prochain rendez-vous qu’elle ne vivrait pas. (…) Pendant ce temps, 64,8% des personnes en parfaite sécurité ont été invitées à consulter immédiatement un médecin. »

OpenAI a dit Le gardien que ces résultats ne reflètent pas la manière dont le service est normalement utilisé et que le modèle est continuellement affiné.