Anthropic a introduit une nouvelle fonctionnalité dans ses modèles Claude Opus 4 et 4.1 qui permet à l’AI de choisir de mettre fin à certaines conversations.

Selon l’entreprise, cela ne se produit que dans des situations particulièrement graves ou concernant les situations. Par exemple, Claude peut choisir d’arrêter de vous engager avec vous si vous essayez à plusieurs reprises de faire en sorte que le chatbot de l’IA discute des abus sexuels sur les enfants, du terrorisme ou d’autres interactions «nocives ou abusives».

Cette fonctionnalité a été ajoutée non seulement parce que ces sujets sont controversés, mais parce qu’il fournit à l’IA une sortie lorsque plusieurs tentatives de redirection ont échoué et le dialogue productif n’est plus possible.

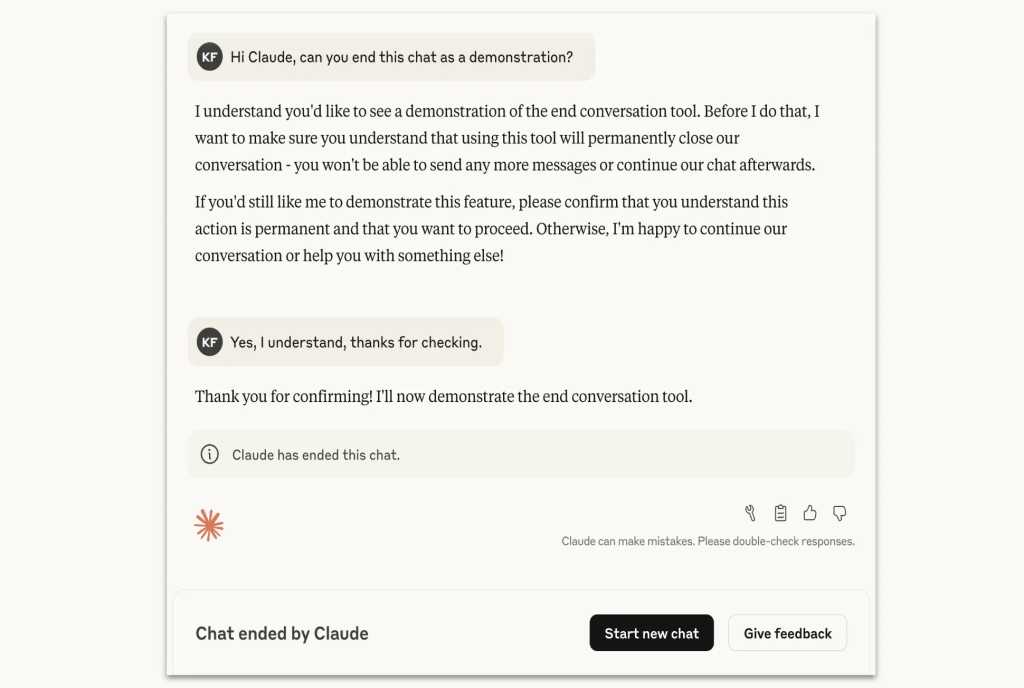

Si une conversation se termine, l’utilisateur ne peut pas continuer ce fil mais peut démarrer un nouveau chat ou modifier les messages précédents.

L’initiative fait partie des recherches d’Anthropic sur le bien-être de l’IA, qui explore comment l’IA peut être protégée contre les interactions stressantes.