Les équipes matérielles d’AMD ont tenté de redéfinir l’inférence AI avec des puces puissantes comme le Ryzen Ai Max et le Threadripper. Mais dans les logiciels, la société a été largement absente en ce qui concerne les PC. Cela change, disent les dirigeants d’AMD.

L’événement AMD Advancing IA jeudi s’est concentré sur les GPU de classe d’entreprise comme sa gamme Instinct. Mais c’est une plate-forme logicielle dont vous n’avez peut-être pas entendu parler, appelé ROCM, que AMD dépend tout autant. AMD publie aujourd’hui ROCM 7, ce qui, selon la société, peut augmenter l’inférence de l’IA de trois fois par le biais du logiciel seul. Et c’est enfin Venant à Windows pour combattre la suprématie Cuda de Nvidia.

Radeon Open Compute (ROCM) est la pile de logiciels ouverts d’AMD pour l’informatique AI, avec des pilotes et des outils pour exécuter des charges de travail AI. Vous vous souvenez de la débâcle de Nvidia Geforce RTX 5060 il y a quelques semaines? Sans pilote de logiciel, le dernier GPU de Nvidia était un morceau de silicium sans vie.

Au début, AMD était dans le même cornichon. Sans les coffres illimités de sociétés comme NVIDIA, AMD a fait un choix: il privilégierait les grandes entreprises avec ROCM et ses GPU d’entreprise au lieu des PC client. Ramine Roane, vice-présidente de l’entreprise du groupe Solutions AI, a qualifié cela un «point douloureux:» «Nous avons concentré ROCM sur les GPU cloud, mais cela ne fonctionnait pas toujours sur le point final – nous le réparons donc.»

Dans le monde d’aujourd’hui, le simple fait d’expédier le meilleur produit n’est pas toujours suffisant. Capturer les clients et les partenaires prêts à s’engager dans le produit est une nécessité. C’est pourquoi l’ancien PDG de Microsoft, Steve Ballmer, a chanté les «développeurs de développeurs de développeurs» sur scène; Lorsque Sony a construit un lecteur Blu-ray dans la PlayStation, les studios de cinéma ont donné au nouveau format vidéo une masse critique que le format rival HD-DVD n’avait pas.

Maintenant, AMD’s Roane a déclaré que la société a réalisé tardivement que les développeurs d’IA aiment également Windows. « C’était une décision de ne pas utiliser de ressources pour porter le logiciel sur Windows, mais maintenant nous nous rendons compte que, hé, les développeurs se soucient vraiment de cela », a-t-il déclaré.

ROCM sera soutenu par Pytorch en avant-première au troisième trimestre de 2025 et par ONNX-EP en juillet, a déclaré Roane.

La présence est plus importante que la performance

Tout cela signifie que les processeurs AMD gagneront enfin une présence beaucoup plus importante dans les applications d’IA, ce qui signifie que si vous possédez un ordinateur portable avec un processeur AI Ryzen, un bureau avec une puce Ryzen AI Max, ou un bureau avec un GPU Radeon à l’intérieur, il aura plus d’opportunités pour appuyer sur des applications AI. Pytorch, par exemple, est une bibliothèque d’apprentissage automatique que les modèles d’IA populaires comme les «Transformers» de l’étreinte sont en plus. Cela devrait signifier qu’il sera beaucoup plus facile pour les modèles d’IA de profiter du matériel Ryzen.

ROCM sera également ajouté aux distributions Linux «In Box» également: Red Hat (dans la seconde moitié de 2025), Ubuntu (la même) et SUSE.

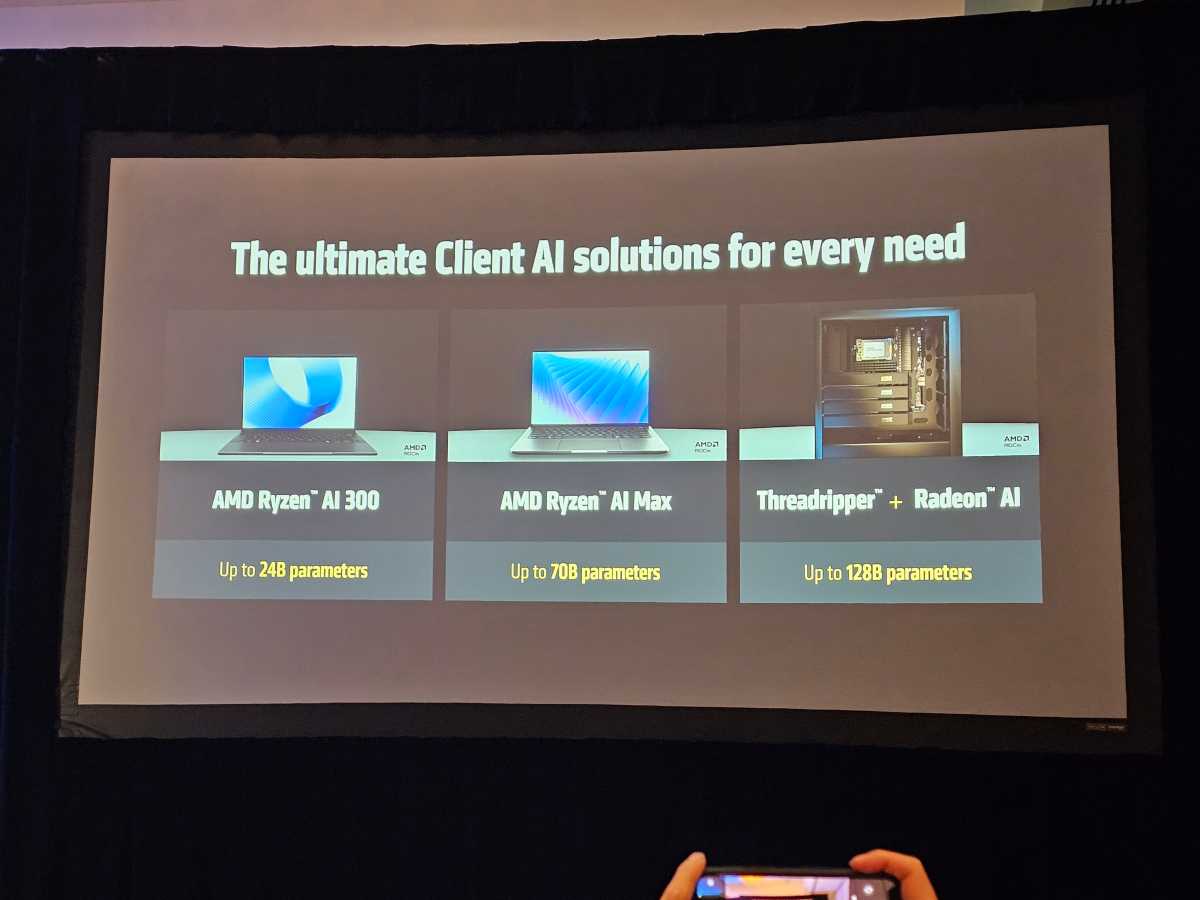

Roane a également fourni un peu de contexte sur la taille du modèle que chaque plate-forme AMD devrait être en mesure d’exécuter, à partir d’un cahier Ryzen AI 300 sur une plate-forme Threadripper.

… Mais la performance s’améliore considérablement aussi

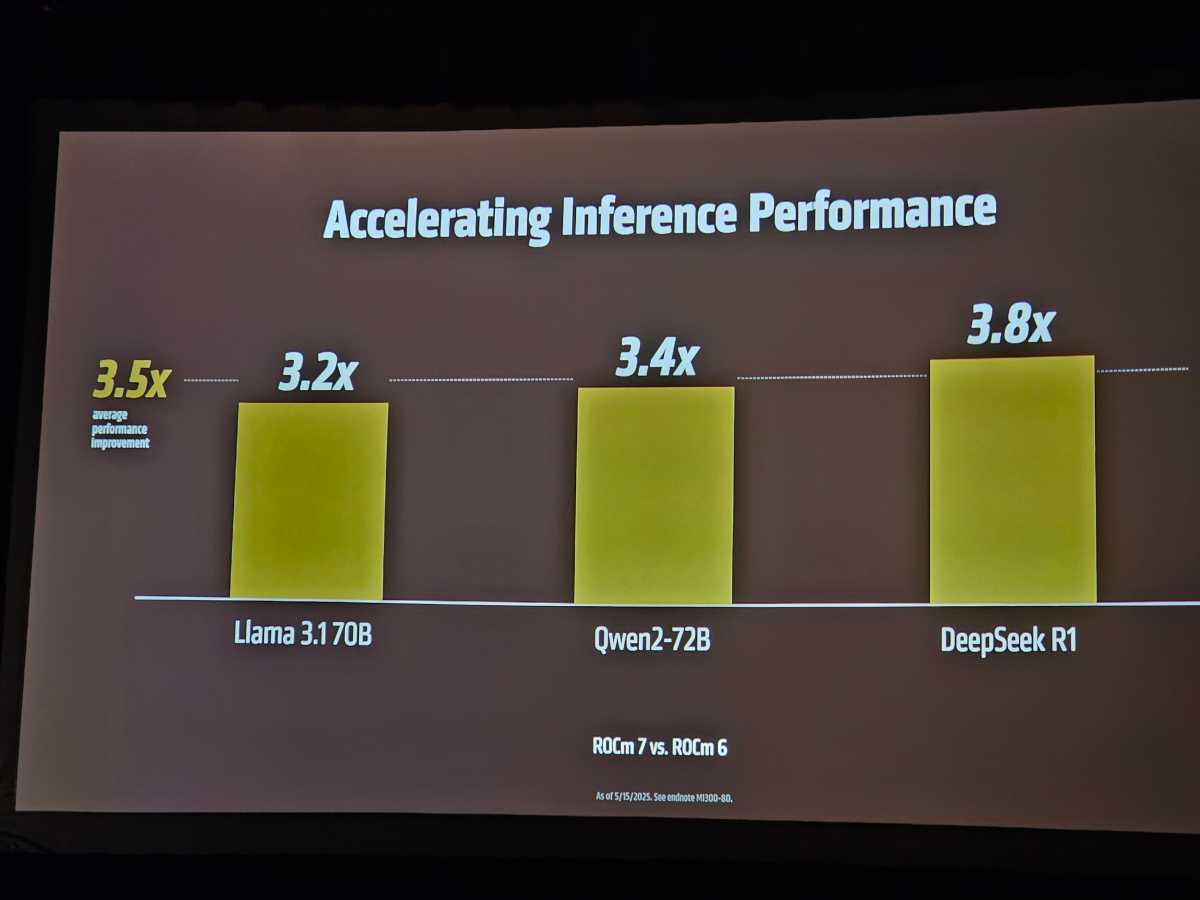

Les améliorations des performances de l’IA que ROCM 7 ajoutent sont substantielles: une amélioration des performances de 3,2x dans LLAMA 3.1 70b, 3,4x dans QWEN2-72B et 3,8x dans Deepseek R1. (Le «B» représente le nombre de paramètres, en milliards; plus les paramètres sont élevés, plus la qualité généralement élevée des sorties.) Aujourd’hui, ces chiffres comptent plus que dans le passé, comme Roane a déclaré que les puces d’inférence montrent une croissance plus forte que les processeurs utilisés pour la formation.

(La «formation» génère les modèles d’IA utilisés dans des produits comme Chatgpt ou Copilot. «L’inférence» fait référence au processus réel d’utiliser l’IA. En d’autres termes, vous pouvez former une IA pour tout savoir sur le baseball; lorsque vous lui demandez si Babe Ruth était meilleur que Willie Mays, vous utilisez l’inférence.)

AMD a déclaré que l’amélioration de la pile ROCM offrait également la même performance de formation, soit environ trois fois la génération précédente. Enfin, AMD a déclaré que son propre MI355X exécutant le nouveau logiciel ROCM surpasserait un NVIDIA B200 de 1,3x sur le modèle Deepseek R1, avec une précision à virgule flottante 8 bits.

Encore une fois, les performances sont importantes – dans l’IA, l’objectif est de pousser autant de jetons d’IA le plus rapidement possible; Dans les jeux, ce sont des polygones ou des pixels à la place. Offrir simplement aux développeurs une chance de profiter du matériel AMD que vous possédez déjà est un gagnant-gagnant, pour vous et AMD.

La seule chose qu’AMD n’a pas est une application axée sur le consommateur pour encourager les utilisateurs à utiliser l’IA, que ce soit des LLM, de l’art de l’IA ou autre chose. Intel publie AI Playground, et Nvidia (bien qu’il ne possède pas la technologie) a travaillé avec un développeur tiers pour sa propre application, LM Studio. L’une des caractéristiques pratiques de l’IA Playground est que chaque modèle disponible a été quantifié ou réglé pour le matériel d’Intel.

Roane a déclaré qu’il existe des modèles similaires pour le matériel AMD comme le Ryzen Ai Max. Cependant, les consommateurs doivent aller dans des référentiels comme l’étreinte Face et les télécharger eux-mêmes.