En résumé:

- PCWorld souligne comment les nouvelles puces M5 Pro et M5 Max d’Apple dans les MacBook Pro constituent une menace importante pour les ambitions de Microsoft en matière d’IA avec leurs capacités supérieures de traitement de l’IA locale.

- Le M5 Max offre jusqu’à 128 Go de mémoire unifiée, dépassant de loin les 32 Go de concurrents comme le Nvidia RTX 5090, permettant aux grands modèles d’IA de s’exécuter localement avec une confidentialité améliorée et une latence réduite.

- Les accélérateurs neuronaux intégrés d’Apple dans les cœurs GPU et le framework MLX créent une plate-forme d’IA plus efficace que l’approche Windows ML de Microsoft.

Les Mac Mini d’Apple sont devenus les chouchous pour exécuter l’IA locale. Les derniers MacBook Pro d’Apple avec leurs nouvelles puces Apple M5 Pro et Apple M5 Max pourraient envoûter encore plus les développeurs.

Apple a lancé cette semaine ses nouveaux MacBook Pro, combinant une paire de puces CPU 3 nm avec une interconnexion entre les deux. Jason Cross de Macworld a noté que la conception à double puce n’est pas nouvelle ; Les processeurs AMD comme le Ryzen 9 5950X ou le 7950X3D utilisent une paire de chipsets connectés à son interconnexion Infinity Fabric.

La nouveauté des puces M5 d’Apple est l’inclusion de « super cœurs » et de « cœurs de performance ». Certains – les « super cores » renommés – sont liés à la marque, comme le souligne Jason. D’autres éléments, comme les nouveaux cœurs de performance, restent quelque peu inconnus. Mais ce qui est vraiment intéressant, c’est qu’ils sont associés à des GPU de 20 à 40 cœurs, chacun doté d’un accélérateur neuronal, ainsi que jusqu’à 128 Go de mémoire unifiée configurable. C’est quelque chose que votre PC Windows ne fait pas et apporte plusieurs avantages aux clients Apple.

À l’heure actuelle, nous ne connaissons pas certains détails concernant les dernières puces d’Apple qu’une analyse approfondie révélerait, peut-être lors de la conférence sur les puces Hot Chips en août. Mais les fonctionnalités descendantes nous en disent suffisamment pour que nous puissions nous émerveiller de ce que fait Apple.

La mémoire compte, et les MacBook M5 Max offrent des performances à la pelle

Parlons tout de suite de l’aspect le plus impressionnant : la mémoire. La puce M5 Max d’Apple comprend une norme de mémoire unifiée de 48 Go, jusqu’à 128 Go. La page de configuration d’Apple est un peu déroutante, mais il semble que tous les ordinateurs portables MacBook Pro 16 pouces soient configurables à cette capacité, mais pour un prix énorme de 4 399 €. Mais c’est une configuration de mémoire unifiée.

Pendant des années, les ordinateurs portables Windows équipés de puces AMD et Intel incluaient une VRAM dédiée : la moitié de la RAM système disponible dans un ordinateur portable Intel, ainsi qu’une version fixe dans un ordinateur portable Ryzen. Lorsqu’AMD a annoncé le processeur Ryzen AI Max pour l’IA locale, il a peaufiné son logiciel Adrenalin pour permettre aux utilisateurs d’ajuster la VRAM à la volée. En août dernier, Intel a lancé le « Shared GPU Memory Override », qui a essentiellement fait la même chose. Qualcomm, dont les processeurs Arm sont les plus proches des M5 Pro et Max d’un point de vue architectural, n’offre pas cette capacité.

Les puces M5 d’Apple utilisent ce qu’elles appellent MLX, un framework de baies open source qui semble amener l’IA locale à un autre niveau. MLX, comme l’explique Apple, n’exige pas que l’utilisateur détermine la quantité de mémoire à allouer. Il ne fait même pas nécessairement le choix lui-même. Au lieu de cela, MLX, qui prend en charge la formation et l’inférence des réseaux neuronaux, y compris la génération de texte et d’images, peut « fonctionner sur le CPU ou le GPU sans avoir besoin de déplacer la mémoire ». Pour reprendre un vieux cliché, ça marche.

Les modèles d’IA engloutissent la mémoire la plus rapide disponible sur votre PC, qui est généralement la mémoire vidéo associée à votre GPU. Le meilleur Les modèles d’IA sont généralement les plus complexes : plus c’est gros, mieux c’est, et les modèles d’IA utilisent le nombre de paramètres comme mesure générale de leur qualité. Mais ces modèles ont également besoin de beaucoup de mémoire pour fonctionner, tout comme Windows ne fonctionnera pas sur un PC avec seulement 2 Go de RAM, et pourquoi Adobe Photoshop en nécessite beaucoup plus.

Donc, en sous-total : les nouveaux MacBook Pro M5 d’Apple incluent jusqu’à 128 Go de mémoire disponible, dont la grande majorité est disponible pour le GPU – dans ce cas, le moteur AI. C’est bien plus que la VRAM locale associée à la carte graphique PC la plus puissante, la Nvidia RTX 5090, à laquelle sont connectés 32 Go de VRAM. Et si vous pensez que 4 399 €, c’est bien trop cher pour un boîtier AI, le MacBook Pro à 3 099 € comprend 48 Go de mémoire unifiée, en standard. Vous voyez l’idée.

Les MacBook d’Apple devraient donc être capables à la fois de charger et d’exécuter des modèles d’IA locaux qui seraient normalement forcés de fonctionner dans le cloud. Cela signifie pas de latence, pas de frais d’abonnement, pas de données sortant de l’appareil pour des applications régies par des lois strictes sur la confidentialité. Les propres estimations d’Apple (ci-dessous) montrent les comparaisons de mémoire de différents modèles populaires, et elles devraient facilement fonctionner sur le MacBook. Doublez l’allocation de mémoire sur le modèle Qwen3 et un modèle à 70 milliards de paramètres devrait être possible. Encore plus cool, Apple a publié quelques lignes de code pour quantifier ou compresser un modèle avec une précision inférieure. C’est astucieux.

Mais la conception d’Apple présente également des caractéristiques de performances impressionnantes. Les processeurs AMD, Intel et Qualcomm incluent chacun un GPU dédié et unifié. Apple ne le fait pas : à la place, il place un NPU (ou au moins un « accélérateur neuronal ») à l’intérieur chaque de ses cœurs GPU. Nous savons que ces accélérateurs neuronaux effectuent des opérations spécifiques de multiplication matricielle dédiées nécessaires à l’apprentissage automatique, et qu’Apple dispose également d’un moteur neuronal distinct à 16 cœurs qui est probablement le nom d’un NPU dédié. Nous ne savons pas vraiment comment tout cela interagit les uns avec les autres.

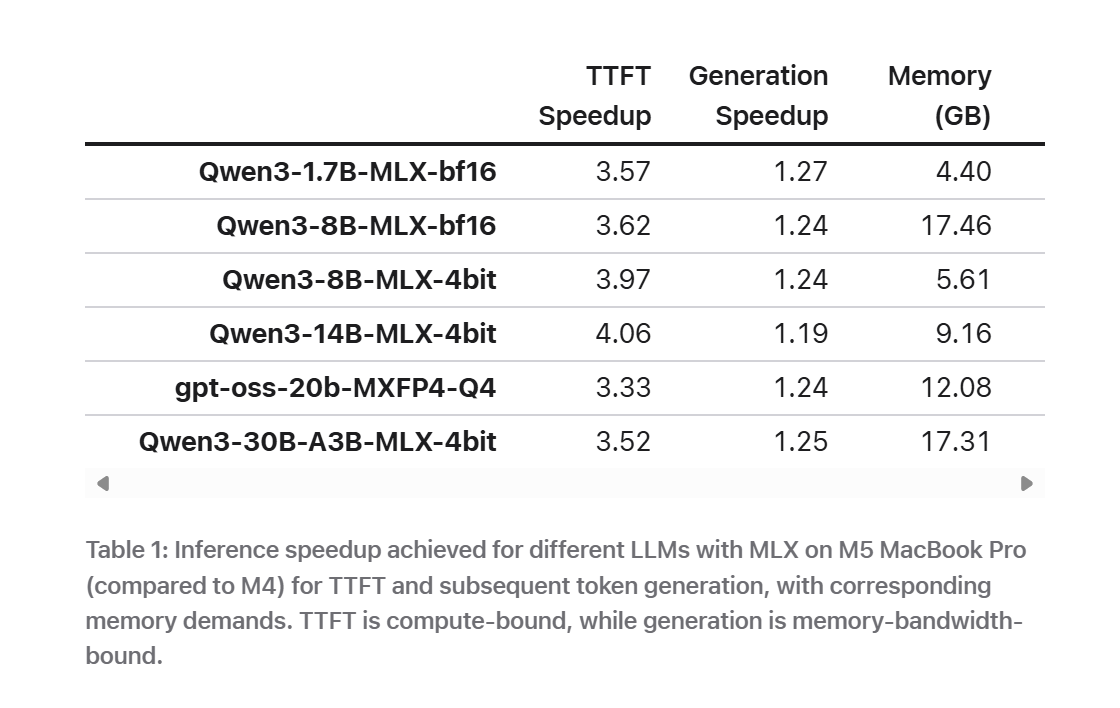

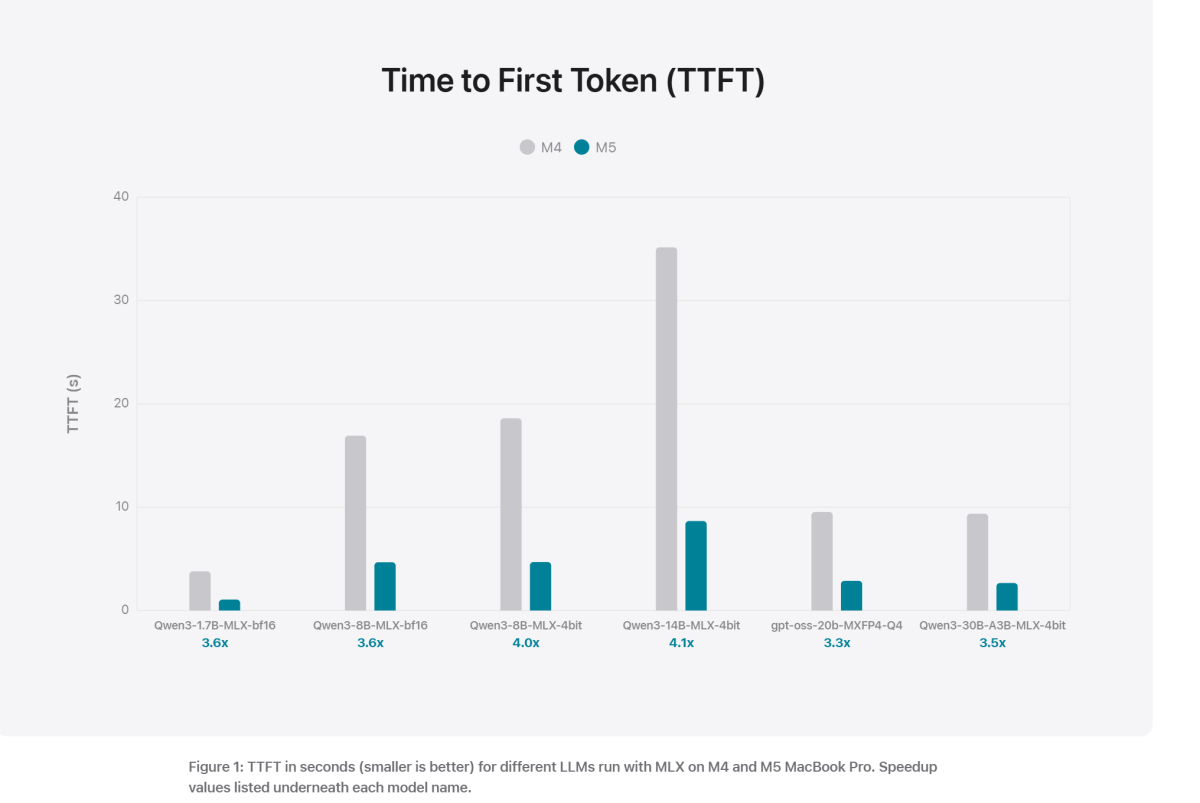

Néanmoins, Apple affirme que le « délai d’obtention du premier jeton » (la rapidité avec laquelle le LLM répond à votre saisie) est considérablement plus rapide, à la fois dans le tableau ci-dessus et dans le tableau ci-dessous.

Personnellement, mon utilisation du LLM n’est pas vraiment dépendante de la rapidité du LLM. J’aime une réponse rapide, mais la manière dont un LLM génère du texte, semblable à celle d’une imprimante matricielle, peut le rendre difficile à lire. La sophistication de la réponse compte davantage.

Le monde Windows peut-il suivre le rythme ?

Pour être honnête, Microsoft a quelque chose de similaire dans son concept : Windows ML, qui tire parti du silicium le plus puissant disponible sur le PC pour exécuter des applications d’IA locales. Cela dit essentiellement que vous n’avez pas besoin d’un NPU, mais simplement du composant le plus puissant disponible sur votre PC. Quelle approche est la meilleure ? Honnêtement, je ne sais pas, même si des tests appropriés devraient révéler la réponse.

Le Ryzen AI Max+ d’AMD est une puissance de l’IA et probablement le plus proche challenger d’Apple. AMD jette 80 Mo de cache au problème d’IA avec l’AI Max+ 395, et l’ajout de mémoire aux processeurs a été une stratégie utilisée avec un excellent effet.

Pourtant, j’ai vu des rapports anecdotiques selon lesquels les employés de l’Apple Store auraient été choqués par le départ des Mac Mini. Mais les petits boîtiers compacts se sont révélés très utiles aux développeurs cherchant à exécuter des LLM ou une IA agentique localement, sans consommer des tonnes d’énergie ni un abonnement à un jeton d’IA. Les nouveaux MacBook Pro d’Apple ajoutent simplement un écran.

Pour autant que je sache, cependant, la Mini n’a pas été conçue pour l’IA. La direction d’Apple étant désormais consciente que le Mini est un appareil d’IA préféré, il sera intéressant de voir ce qui se passera avec le Mac Mini Apple 2026 attendu avec une puce M5 à l’intérieur. Tout cela place certainement la barre haute pour AMD, Intel et Qualcomm.